聊天讨论 开发&小白不用愁:Gemini 3.1 Pro API 接入(支持原生)+ Cherry Studio 配置,一篇全搞定

Gemini 3.1 Pro 你用上没?谷歌说推理能力比 Gemini 3 Pro 提升了一倍以上,有没有那么厉害?本文将全面介绍 Gemini 3.1 Pro 的核心能力以开发者如何调用 Gemini 3.1 Pro API,普通用户如何快速使用。

一、Gemini 3.1 Pro 打造全能型推理大脑

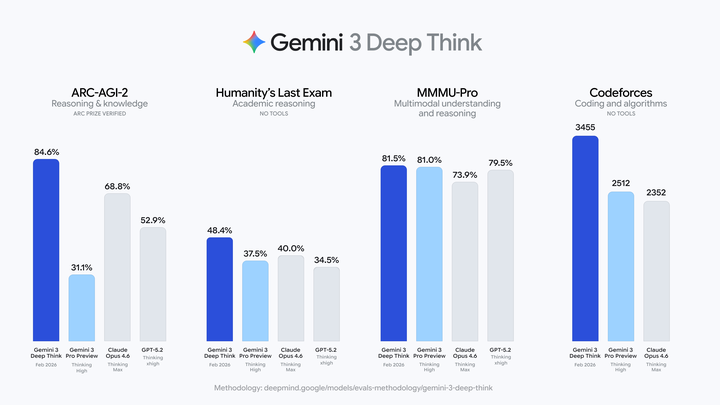

ARC-AGI-2 到底再测什么,77% 意味什么?

Gemini 3.1 Pro 在极具挑战性的 ARC-AGI-2 基准测试中,取得了 77.1% 的得分,推理性能比上一代产品提升了一倍以上。三个月前的 Gemini 3 Pro 拿了 31.1%,放在当时不算差。但这次 3.1 Pro 直接干到 77.1%,同样主攻推理路线的 OpenAI o1 和 GPT-5.2,在这项测试里只有 52.9%。

这个基准测试考的不是知识储备,而是推理能力。这项测试的特别之处在于:它只给你几个网格图案作为 “例题”,需要你自己推导出背后的变换规则,然后应用到全新的图案上。

对人类来说这种推理几乎凭直觉就能完成,而 AI 却没法靠死记硬背,也没法用统计猜答案——必须真的理解逻辑。正因为卡在了 “人类擅长、AI 不擅长” 的地方,ARC-AGI 一直被看作衡量通用人工智能(AGI)进程的重要标尺。

77.1% 这个数字背后,是 Google 找到了规模化推理能力的有效路径。 当别的模型还在靠堆参数硬扛时,Gemini 3.1 Pro 已经在 “理解逻辑、推演规则” 遥遥领先。

三级思考模式怎么个省钱法?

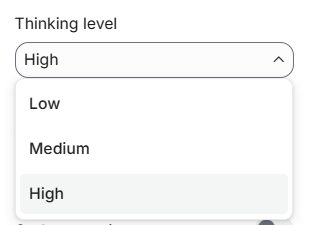

过去的 Gemini 模型在只有两个档位——快速应答(Fast)和深度推理(Deep Think)。要么秒回,要么思考一大串半天才输出想要的内容。

Gemini 3.1 Pro 增加了一个中间档位,升级了成了三级思考系统。开发者可以在 “thinking_level” 参数灵活切换低、中、高三档,每个档位在内部都有一个 “思考 Token” 的预算,这直接决定了模型会花多少精力进行内部推理。在处理简单的 API 调用时,使用低档位来节省延迟和成本;遇到复杂调试时,则切换到高 档位。 Low (低):快速响应模式,思考 Token 预算最低,模型凭直觉快速应答,适合日常简单任务。模型会基于直觉和训练数据,给出最直接的答案,思考过程最短,相比上一代的 Fast 模式,响应速度更快,成本更低——简单任务上,比用高 档位能省下 60%-80% 的推理成本。

Low (低):快速响应模式,思考 Token 预算最低,模型凭直觉快速应答,适合日常简单任务。模型会基于直觉和训练数据,给出最直接的答案,思考过程最短,相比上一代的 Fast 模式,响应速度更快,成本更低——简单任务上,比用高 档位能省下 60%-80% 的推理成本。

Medium (中):平衡推理模式,思考 Token 预算适中,进行中等深度逻辑分析。模型会进行中等深度的逻辑分析,其推理质量相当于上一代模型 (Gemini 3 Pro) 的 “高” 档位,但成本只有那款的 40% 左右。这意味着你可以用更少的钱,办和以前一样复杂的事。

High (高):深度推理模式 (Deep Think Mini),思考 Token 预算最高,适合专业复杂任务。模型会激活类似 “Deep Think” 的强大推理引擎,进行极其深入的多步骤思考,以达到最佳效果。虽然成本比中低档位高,但相比上一代的 Deep Think 模式,同等深度下成本降低了约 30%——因为架构优化了,钱花得更值。

多模态原生支持,感知维度的全面扩展

无需预处理,原生理解:模型原生支持文本、图像、音频、视频、PDF 和代码,无需 OCR 或预处理工具。上传含图表的研究论文,模型能同时读取文字和理解图表;输入代码,能同步分析逻辑和注释。

跨模态信息无缝融合:真正的多模态意味着能在不同模态间建立联系。Gemini 3.1 Pro 可对视频画面、音频解说和文字字幕进行交叉推理,让复杂任务的理解建立在更丰富的感知维度之上。

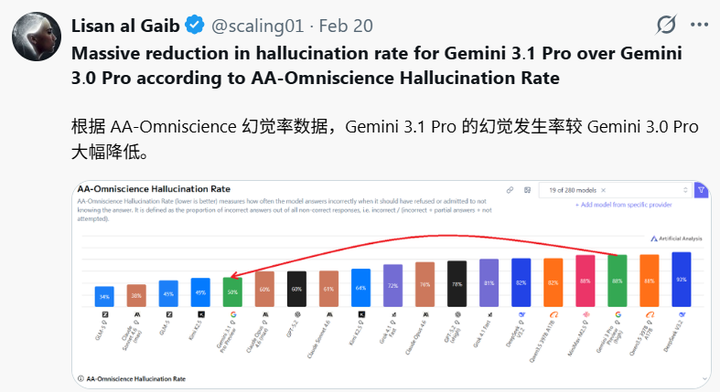

更低的幻觉率,知道自己不知道什么

AA-Omniscience Index 跃升:该指标衡量模型的 “自知之明” 也就是对自身知识边界的认知(抗幻觉)。Gemini 3.1 Pro 从上一代 13 分跃升至 30 分,位居主流模型第一——这意味着它拒绝回答不熟悉问题的准确率更高,在擅长领域给出错误信息的概率更低,减少胡说八道的概率。

对专业推理的意义:在代码调试、学术研究等严谨场景,“不知道” 比 “乱猜” 更安全。这种能力源于模型对知识边界的清晰建模,在 HIGH 档位下,模型会花更多时间进行内部验证,进一步降低关键任务的幻觉风险。

二、Gemini 3.1 Pro 的真实表现:

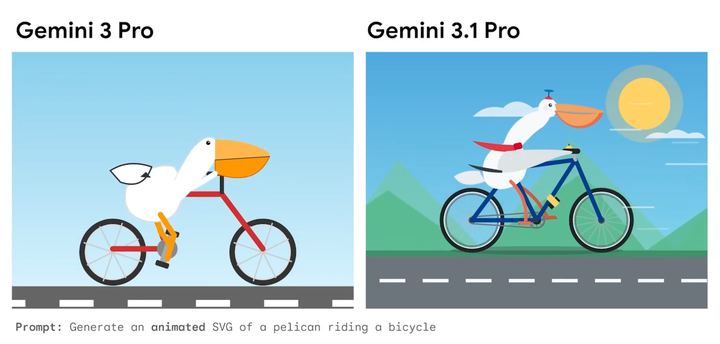

代码生成 SVG 动画

只需一句简短的文字描述,Gemini 3.1 Pro 能根据文本指令为网站生成 CSS/JavaScript/SVG 代码形式的动画 SVG 。以前需要以视频或 GIF 形式呈现的动画,现在可以使用 3.1 Pro 直接以代码形式生成,开发人员可以轻松调整细节也可以直接应用。这些矢量动画无限缩放依然锐利无比,文件体积极小,远轻于传统视频或 GIF,完美适合网页嵌入。 整合复杂系统

整合复杂系统

Gemini 3.1 Pro 像个全能的 “翻译 + 技术” 中间人。你只需说 “做个空间站实时看板”,它就能自动听懂需求,主动去对接那些晦涩的航天数据 API,把复杂的专业代码瞬间转化成带电量表和 3D 模型的直观界面。整个过程无需写代码,自己就把从技术到设计的事全干了。 交互设计

交互设计

Gemini 3.1 Pro 能生成复杂的 3D 椋鸟群舞动画,打造沉浸式体验。它基于 3D 算法模拟椋鸟群飞,用户可通过手部追踪技术实时操控鸟群飞行方向与轨迹。鸟群运动时,系统还会同步生成动态配乐,将视觉与听觉融合,为交互设计与创意编程提供了高效的原型验证。 创意编程

创意编程

Gemini 3.1 Pro 能将文学意境直接转化为可运行的网页代码。比如让它为《呼啸山庄》设计一个现代风格的个人主页,模型不只是复述情节,而是深入抓住原著那种压抑、狂野又深沉的情感基调,把主角的灵魂底色完美呈现出来。这不只是代码生成,而是 AI 真正读懂并诠释了文学内核。

三、如何使用 Gemini 3.1 Pro ,低价调用官方 API

开发者可以通过Google Ai studio使用预览版进行构建,普通用户则可以通过 Gemini APP 或官网:https://gemini.google.com/ 但目前优先给 Pro 和 Ultra 用户使用。有没有其它方法免费体验,当然有往下看!

Gemini 官方源头 API——Grsai

虽然 Gemini 3.1 Pro 的 API 定价与上代 3.0 Pro 持平(输入 2 美元/M tokens,输出 12 美元/M tokens),但这个价位对个人用户和企业来说仍不算低。市面上的第三方 API 往往价格虚高,存在中间商赚差价。其实你可以直接调用 Gemini 的源头 API——GrsAi(https://grsai.com,需魔法;com 改 AI 可国内直连),能以比官方更低的价格调用 Gemini-3.1-Pro、Nano Banana Pro(绘图)等模型。

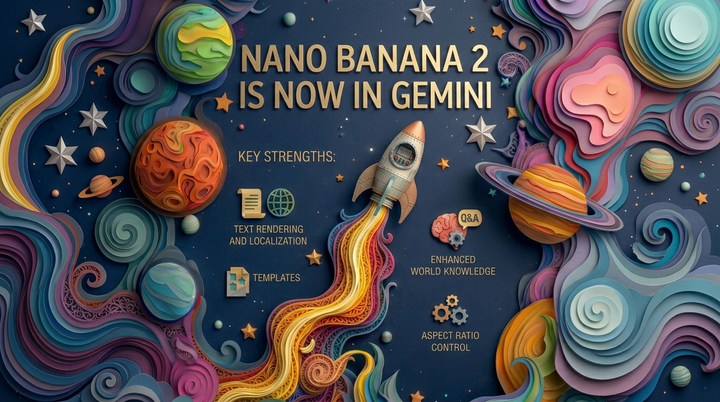

画图模型:

- Nano Banana 2—— 0.065/张

- Nano Banana Pro—— 0.09/张

- Gpt-image-1.5——0.02/张

- Nano Banana——0.022/张

对话模型:

- Gemini-3.1-Pro:input¥1~¥2 /M tokens,output ¥6~¥12 /M tokens

- Gemini-3-Pro:input¥1~¥2 /M tokens,output ¥6~¥12 /M tokens

- Gemini-2.5-Pro:input¥1.25~¥2.25 /M tokens,output ¥6.25~¥12.5 /M tokens

视频模型:

- Sora2——0.08/条

- Veo3.1——0.4/条

更多模型版本请看模型列表:https://grsai.com/zh/dashboard/models (需要魔法,没有 com 改 ai)

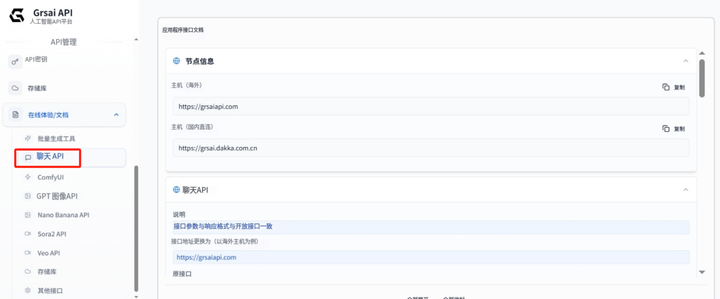

四、开发接入 Gemini 3.1 Pro APi 教程

API 节点信息

Grsai 提供两种接入地址(base url),根据网络环境选择:

- 海外:https://grsaiapi.com

- 国内直连:https://grsai.dakka.com.cn

- Host+ 接口:https://grsai.dakka.com.cn/v1/draw/nano-banana

## Chat API 调用说明

## Chat API 调用说明

Grsai 的 Chat API 完全兼容 OpenAI 和 Gemini 格式,OpenAI 只需替换基础地址,Gemini 则需要替换基础地址和模型名称即可调用。

方式一:通过 Grsai 调用(OpenAI 兼容格式)

- 原 OpenAI 接口:https://api.openai.com/v1/chat/completions

- 更换后的接口地址:https://grsai.dakka.com.cn/v1/chat/completions(以国内直连为例)

- OpenAi API 文档:https://platform.openai.com/docs/api-reference/chat/create?lang=curl

import openai

# 配置Grsai地址和密钥

client = openai.OpenAI(

api_key="你的APIKey",

base_url="https://grsai.dakka.com.cn/v1" # 国内直连地址

)

# 调用Gemini-3.1-Pro

response = client.chat.completions.create(

model="gemini-3.1-pro",

messages=[

{"role": "system", "content": "你是一个航天数据专家"},

{"role": "user", "content": "分析国际空间站的轨道数据"}

],

stream=False

)

print(response.choices[0].message.content)

方式二:通过 Google 官方 SDK 调用

- 原 Gemini 接口:https://generativelanguage.googleapis.com/v1beta/models/gemini-3.1-pro-preview:generateContent

- 更换后的接口地址:https://grsai.dakka.com.cn/v1beta/models/gemini-3.1-pro:generateContentGrsai 后台一样) (模型名称需要和

- Gemini API 官方文档:https://ai.google.dev/gemini-api/docs

import requests

import json

# Grsai国内直连节点 + Gemini原生接口路径

url = "https://grsai.dakka.com.cn/v1beta/models/gemini-3.1-pro:generateContent"

# 你的Grsai API Key

api_key = "你的Grsai-APIKey"

# 请求头

headers = {

"Content-Type": "application/json"

}

# 请求体(Gemini原生格式)

data = {

"contents": [

{

"parts": [

{

"text": "解释一下什么是矢量图"

}

]

}

]

}

# 发送请求(API Key通过URL参数传递,这是Gemini的风格)

response = requests.post(

f"{url}?key={api_key}",

headers=headers,

json=data

)

print(response.json())

五、普通用户使用 Gemini 3.1 Pro 教程

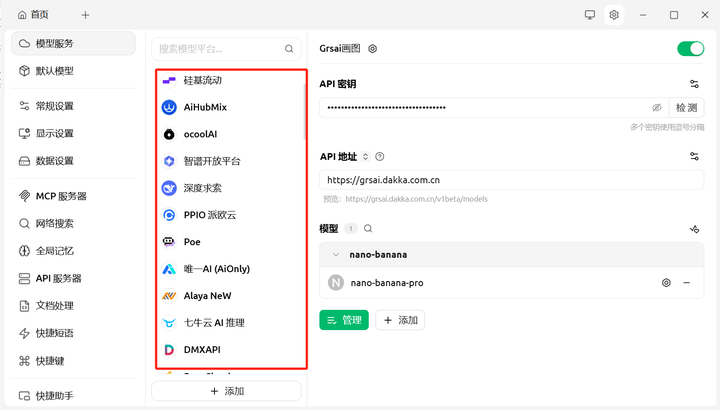

普通用户可以通过下载 Cherry Studio、Chatbox 等工具,将各种主流大模型统一集成到一个简洁的界面里。你只需简单配置 API,就能自由调用不同模型的服务,无需频繁切换网页或应用。这些工具的配置方法基本相似,跟着我的步骤一步步操作,你也能快速用上 Gemini 3.1 Pro。

下面是针对 Grsai 平台的详细配置步骤,跟着做基本 3-5 分钟就能用上 Gemini-3.1-Pro 和 Nano Banana Pro 等模型。最重要提醒:模型名称必须从 Grsai 官方开发文档(Chat API 部分)直接复制粘贴,千万不要自己手打!哪怕多一个空格或大小写不对,都会导致连接失败。

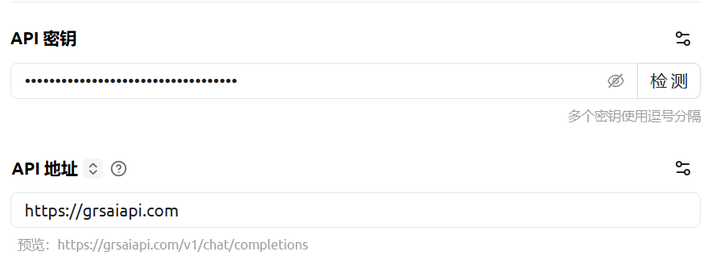

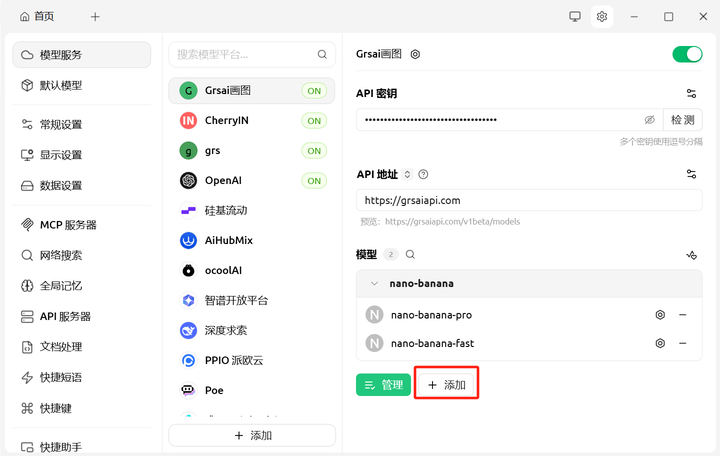

1.进入设置页面:下载安装:Cherry Studio - 全能的多模型 AI 助手 | 免费开源,启动 Cherry Studio 后,点击右上角的 “设置” 图标(通常是一个齿轮形状)。

2.添加模型服务:在设置菜单中,找到并点击 “模型服务” 点击添加,输入供应商名称(自定义随意写),模型提供商 OpenAI 和 Gemini 都支持。

3.填写供应商信息:

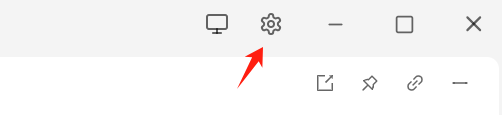

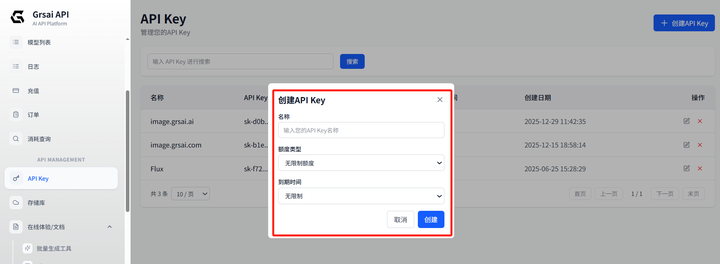

在 Grsai 控制台创建ApiKey( https://grsai.com/zh/dashboard/api-keys com 域名访问需要魔法,没有改成 ai)复制黏贴。

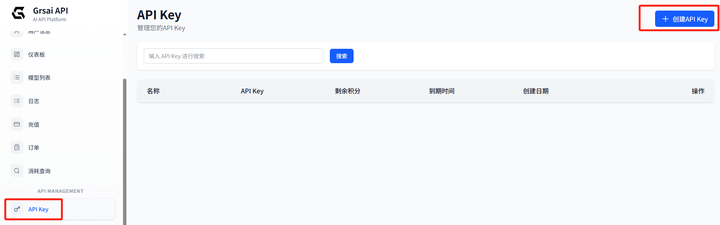

Cherry Studio 黏贴 ApiKey(保密不可外泄)和 APi 地址(base url):https://grsaiapi.com

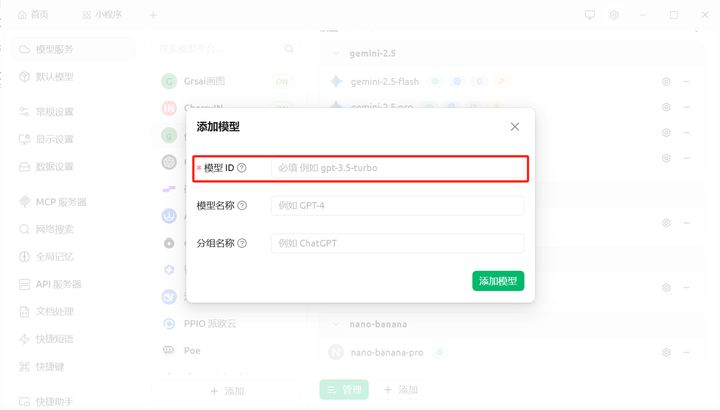

填完 Api 秘钥和地址后需要手动添加模型

填入 Grsai 后台所支持的模型名称:

画图模型:

- nano-banana-fast

- nano-banana-pro

提问模型:

- gemini-3-pro

- gemini-3.1-pro

- gemini-2.5-pro

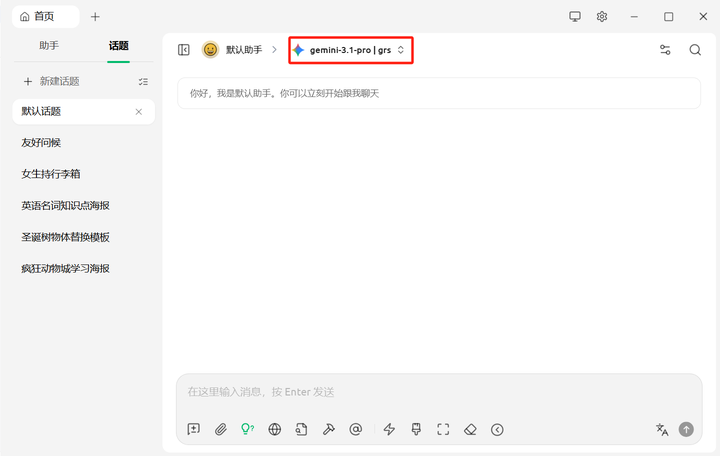

设置完后返回助手页,选择模型使用。

配置完成后,你就可以用 Cherry Studio 使用 Gemini 3.1 pro,如果你有批量生图的需求 Cherry Studio 就不适合你,每次都需要等待对话结束才可以继续提问,你可以用 Grsai 提供的开源免费批量生图工具。

1.获取 APIKey:Grsai 控制台设置ApiKey( https://grsai.com/zh/dashboard/api-keys com 域名访问需要魔法,没有改成 ai),复制 ApiKey

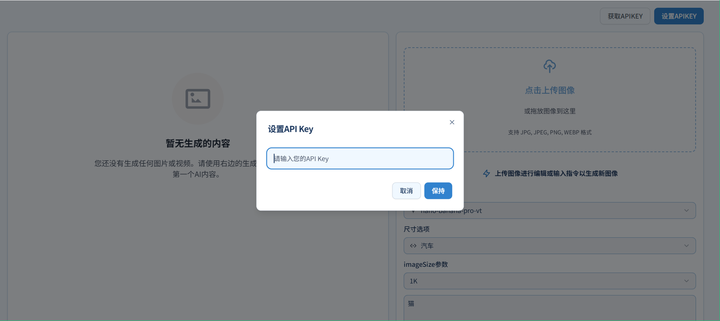

2.配置 API:打开批量生图工具(https://image.grsai.com/ com 域名访问需要魔法,没有改成 ai),右上角设置 APIKey,黏贴你的 API Key

3.生成:上传图片,选择模型,尺寸输入提示词即可使用

3.生成:上传图片,选择模型,尺寸输入提示词即可使用

六、总结

这次 Gemini 3.1 Pro 的升级主要是让推理能力翻倍、花费更少、幻觉更低。无论你是开发者想调用 API,还是普通用户想通过 Cherry Studi 或其他第三方工具使用 3.1 pro,不妨参考我的攻略一步步操作。